- 株式会社マクロミル

- デジタルマーケティング事業部 ゼネラルマネージャー

- 遠藤 直子

「50億分の1」アクセスも取りこぼせない!マクロミル流・ビックデータ解析術

今回のソリューション:【Treasure Data Service/トレジャーデータサービス】

〜50億のデータを取りこぼすことなく収集・解析するのに役立った「Treasure Data Service」の使い方〜

ネットリサーチを手がける株式会社マクロミルは、2014年に「人がデジタル広告から受ける印象」を測ることができる新サービス「AccessMill(アクセスミル)」を正式リリースし、月間50億のアクセスを捌くまでに成長させた。

今回は「50億アクセスの中で1つも取りこぼすことなく、データの収集・解析を行わなければならない」と語るのは、同サービス開発チームの遠藤 直子さんと岡澤 哲也さん。同社が解析のために導入しているデータマネジメントサービスが「Treasure Data Service(トレジャーデータサービス)」と「AWS OpsWorks(オプスワークス)」だ。これらを活用しながらどのようにこの厳しい要件をクリアしているのか、話を聞いた。

組織の改変者と元Android開発者のタッグで開発

遠藤 システム開発部門で「Quick-CROSS(クイッククロス)」というアンケート集計ツールの開発、その後、新規事業の立ち上げや組織の立て直しを担ってきました。現在はシステムマーケティングリサーチ全般の基幹サービスを運用している部門の部門長として組織の改変をしながら、AccessMillのサービス開発全体の統括もしています。

岡澤 マクロミル入社以前は、ベンチャー企業でAndroid部門を設立し、部門長をしていました。当時はスマートフォンが出たばかりの頃で、iOSを手がける企業が多い中で同じことをしても面白くないので、より難易度が高そうだったAndroidにチャレンジしていこうと。マクロミルには2013年頃入社し、新規事業の立ち上げに携わった後、AccessMillの開発チームに入りました。

>

>

デジタルマーケティングへの挑戦

遠藤 近年、アドテクノロジーの進化でオンライン広告の需要が増加し、それに伴いオンライン広告と従来型の広告の効果を比較・検証するニーズも非常に高まっています。そして広告予算を効率良く投下するために、クリック数などの一般的な広告KPIといった定量情報に加えて「商材の理解度」「好感度」「認知度」「購買意向」などの意識データも含めて検証することが求められるようになりました。

このような流れの中で、我々は自社の100万人を超えるマクロミルモニター(アンケート専用モニタ)の行動ログと意識データを基軸に広告効果測定をおこなうAccessMillを独自開発し、2014年に正式リリースしました。

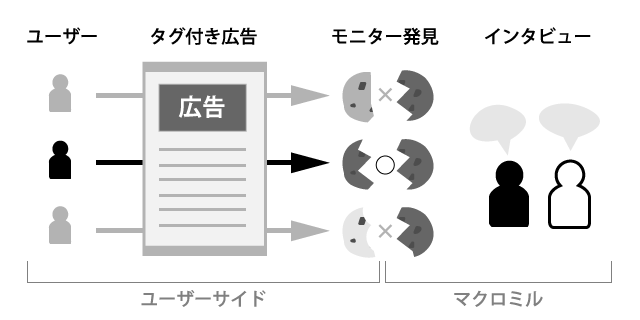

AccessMillはデジタル広告の効果を定性情報まで測ることができるサービスです。まず、マクロミルモニタのCookie情報を活用し、お客様のサイト上の広告に対して接触しているか否かを把握します。その後、広告に接触していた人に対してアンケートを実施し、そこで得た意識データとその方と属性を用い、広告効果を検証するというサービスです。WEB上での行動ログの取得には、弊社独自システムのタグを用います。

詳細でリアルな属性データを把握でき、アンケートも実施できるので、通常のアクセス解析ツールや配信ツールでは把握できない「商品の認知」といったブランディング効果まで測ることができます。

3ヶ月で1アクセスも取りこぼせないシステムを開発

遠藤 AccessMillのサービス実現のためには、単にログを蓄積するだけではなく、大量のアクセスログデータをいかに処理していくかが重要です。また、アクセスログデータをアンケートデータと結びつけていくために、いかに精度高く集計処理をしていくかが肝になります。

第一フェーズの開発は、これから進化させていくAccssMillのベースとなるので、岡澤をはじめとしたチームメンバーに対し特にアーキテクト面で非常に強い要求をしました。マクロミルのスタッフが使うフロント部分は多少目をつぶっても、データ収集・処理部分は納得のいくものに仕上げたかった。それは開発メンバー全員の思いでもあったと思います。

岡澤 AccessMillはお客様のサイトから取得したアクセスデータを元にするため、システム開発では「1アクセスも取りこぼさず大量のデータをリアルタイムで処理していくこと」を最重視しました。

結果、アクセスデータの正確性とリアルタイム処理を両立しなければならず、テストが非常に大変でした。開発期間が3ヶ月しかありませんでしたが、テストで見つかった問題は、仕様を組み直し突貫工事で解決していきました。

24時間365日休まずデータを収集・解析し続ける

岡澤 システムの肝となる「データの収集・解析」は24時間365日休むことなく行う必要がありました。AccessMillを埋め込んでいるメディアサイトには常にユーザーがアクセスしている状態なので、データ収集部分が休んでしまえばアクセスデータを取りこぼしてしまうんです。

ただ、この「24時間365日休むことなくデータを収集する」という要件を自社だけで実現しようと思うと、耐障害性や可用性に対するコストが非常に高くなります。そのため、他社のサービスを利用して作る発想に切り替え、Treasure Data Serviceを導入することにしました。

対面コミュニケーションのように応答が早いチャット

遠藤 Treasure Data Serviceを導入した当初は、データがどんどん溜まっていきお金が取られているだけ、という勘違いをしていました(笑)。その後、Treasure Data Serviceの研究をしたり、自分達で使い込む中で価値を理解していったんです。

岡澤 トラブルが起きてしまった時に、Treasure Data Serviceを導入したことにありがたみを感じました。具体的には、対応スピードが非常に早いことやトラブルのレポーティングがもらえる点が良かったです。

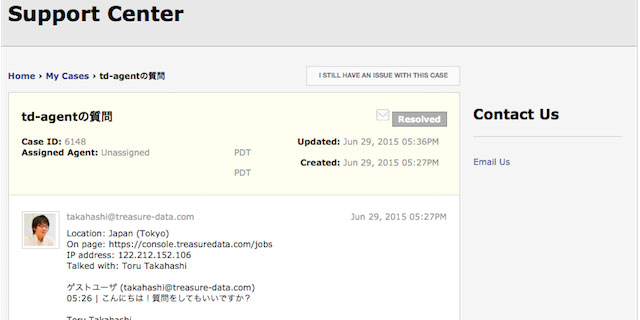

▼対応スピードも早く、充実した機能を備えたサポートセンター

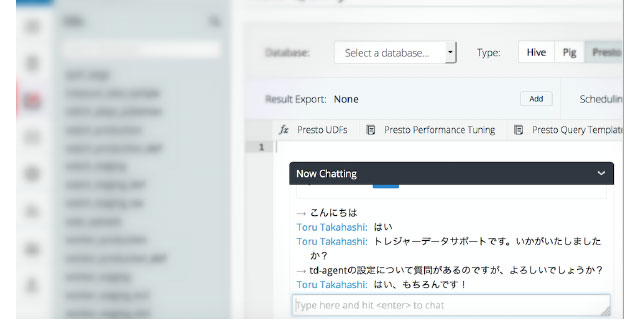

また、一番良いのはコンソール上でTreasure Data Serviceの担当者の方とチャットできる点です。フレンドリーに相談ができてスピーディーにレスポンスが返ってきます。「すみません!」「はい、なんでしょう。」といった感じで返ってきます(笑)。担当の方の名前も分かっているので非常に楽です。

▼コンソール上からすぐにチャットの開始が可能

敢えて手動でスケール アクセスを取りこぼさない

岡澤 アクセス数が増大した時は、基本的にAWSのOpsWorksの自動スケールで対応していますが、極端に増大する場合はタイムベースを使い手動で対応しています。

極端に大きなアクセスに自動スケールで対応すると、その瞬間にサーバーの台数を増やさなければならず起動に数分かかり、対応が間に合わない場合があります。これを防ぐために、営業サイドから「何日の何時に大量のアクセスがある」という話をキャッチした時は、タイムベースを使ってそのタイミングだけ手動でスケールさせています。そして、必要がない時はその分のサーバーを落としてコストを抑えています。

月間150億のアクセス数を目指す!

岡澤 今後もAccessMillをどんどん成長させていきたいので、開発側としては、月間100億、150億といったようなアクセス数をさばけるシステムにしないといけません。150億までいけば、国内の最大手のポータルサイト並みのアクセス数になるのですが、それでを1アクセスも取りこぼさずに捌くにはどうしたらよいかを考えて、今後の改善策を提案していく予定です。AccessMillのシステム開発は難易度が高く技術者が心動かされるような仕事がまだまだありますので、とてもワクワクしています。