- 日本アイ・ビー・エム株式会社

- アナリティクス事業本部 第二テクニカル・セールス

- 田中 裕一

「データは新しい天然資源」 Apache Sparkで実現する、IBMの「Open for Data」戦略

今回のソリューション:【Spark/スパーク】

〜IBMが見据える、ビッグデータ活用の未来とは? 3,500人を投入したSparkの一大プロジェクトや、「Open for Data」戦略の全貌を公開〜

ビッグデータ処理フレームワーク、Apache Spark(スパーク)。大量のデータをインメモリで処理することで、従来のシステムより高速なデータ分析が可能となり、ビッグデータの活用の幅が広がるきっかけとなった。

IBMも、その技術に注目する企業のひとつだ。同社では、3,500人もの研究者・開発者をSparkに投入し、技術開発を進めている。

その裏にあるのは、「新しい天然資源」であるデータがオープン化され、より幅広く活用されていく未来を見据えた「Open for Data」という戦略だ。

同社ではその実現のため、データ分析の入り口から出口までをカバーするソリューションを提供するのみならず、技術者の教育のためのライブラリ、ツールの無償提供なども行っている。

今回は、日本アイ・ビー・エム株式会社でSparkの第一人者である田中 裕一さんに、Sparkの特徴や活用される領域、そして企業のデータ活用は今後どう変化していくのか、詳しいお話を伺った。

幅広い業種のデータ分析に携わるため、IBMに入社

私は、前職ではビッグデータ系のR&Dをしていました。当時から、これからは企業でデータの重要性が増してくるという考え方が、私の周りでは有力になってきていましたね。その中でも、Apache Sparkは、様々な領域でブレイクスルーを起こしていくのではないかと思っています。

私はSpark単体の技術というよりも、データ技術がどのように業界で使われていくのか、というところに興味があります。

前職でもSparkを使った仕事をしていましたが、関われる業種がECに限られていたんです。より多様な業種でSparkを活用できる会社を探していたところ、IBMがSparkに力を入れているということを知りました。

弊社では、金融や製造業などの幅広い業種を対象に、Sparkを使ってデータ分析の基盤を構築します。Web系の企業ですと、Sparkのようなオープンソースがたとえ不安定な状態だとしても、積極的にプロダクションに取り入れますよね。

そのように早いうちから新しい技術を取り入れていくと、どんどんナレッジが蓄積されていきます。

一方で、製造業や金融の場合、それは難しく、さらに情報を積極的に出すこともないので、ナレッジが残りにくいんです。そこが課題かなと感じています。

「データは新しい天然資源」 データの売り買いが始まっていく時代へ

私が入社したきっかけにもなるのですが、IBMには「データは新しい天然資源だ」という考えがあります。

今は大量のデータを集めて分析をしても、自社だけで活用していくというフェーズですね。その先には、データ自体にもっと価値が出てきて、データが売り買いされる時代になっていくと。

例えば、Weather Companyという気象情報を扱う会社では、世界中に20億くらいのセンサーを持っています。天候情報を企業に対して提供し、企業は自社のデータと組み合わせて、新しいナレッジを見つけて活用していきます。

例えば天候に応じてコンビニが発注を決めたり、コーヒーショップが特定の地域に対して割引をするといった活用が考えられますね。

ビッグデータの活用は、業種を越えて広がりつつある

私が関わっているこのSparkのプロジェクトでは、最近では製造業のようなお客様でも、「ビッグデータを活用したい」というお話が多いですね。製造業のどこでビッグデータが活用できるのかというと、例えば製品を作る機械の故障予防です。

製品が規格通りに作られているか、センサーから大量のデータを集め、それを高速に処理します。そして歩留まり率が他の機械よりも悪いものがあれば、「この機械おかしいんじゃないの?」ということに気づくことができ、故障の予防に繋げることができます。

そういったお客様が、HadoopやSparkといった技術について知り、「実際に使ってみたいけどどうなのか」という相談をお受けすることがあります。

HadoopとSparkの違いが分からない方も多いので、Sparkはこういうもので、得意な所はどこで、過去にこういう事例があって…といった話をさせてもらっています。

Sparkによる高速なデータ分析は、新たな価値の創出に繋がる

Hadoopというものは、大量にサーバーを並べて、分散処理をさせることで高性能なデータ処理ができるという技術です。

Hadoopのおかげで、一般の企業でもコモディティ化されたサーバーを大量に並べるだけで、ビッグデータを活用できるようになった。これがHadoopが浸透した背景です。

ただ、企業がデータを活用していく中で、データ量が100TBや数1000TBとどんどん大きくなっていきました。すると、Hadoopで分散処理をしたとしても、ひとつのクエリに対して2、3日結果が返ってこない、という「スピードの課題」が出てきたんですね。

それと同時に、サーバーのメモリの価格も下がってきました。Hadoopが出てきた当時はハードディスクが一番安価でしたが、時代が変わって1台のサーバーに512GBのメモリを簡単に載せることが出来るようになりました。

できるだけメモリ上でデータを処理したほうが、当然早いですよね。そのようなコンセプトを背景として生まれたのが、Sparkという技術です。

高速にデータ分析ができるということは、ひとつの大きな価値になります。例えば、Webサービスのレコメンデーション機能が、2〜3日に1回しか変わらない、ということではビジネス的にロスになります。

これがSparkを使って、次の日には反映されるようになれば、より最適なレコメンドができるようになります。

「Sparkを使う」のではなく「データを活用する」ための基盤を提供

そもそもビッグデータの分析基盤は、HadoopやSparkを入れただけだと未完成なんです。Hadoopはあくまでもデータ分析をするための基盤で、それ以上でもそれ以下でもありません。

例えば画像データや、最近ではストリーミングの映像データも増えてきていますね。そのようなデータは、通常データベースには入っていません。ただ、弊社のWatsonを使えば、写真に何が写っているかという情報が取れるので、データ分析に活用できますよね。

そういったデータ分析に必要な環境を統合したり、分析の部分もGUIできるような、エンジニアでもデータサイエンティストでも使いやすい環境を提供しています。要するに、ビッグデータの活用環境をトータルで提供しているんですね。

そもそもお客様はHadoopが使いたいわけでもないし、Sparkが使いたいわけでもないです。データを活用したいだけなんです。

だから、とりあえずSparkだけ突っ込むようなことをすると、失敗します。データの入り口から出口までを、トータルで設計することが必要です。

「Open for Data」の実現には、教育も必要

弊社では「Open for Data」という戦略を掲げていて、その一環として、企業間でデータを売買できるマーケットプレイス「Analytics Exchange」を提供しています*(2016年5月現在 β版)。

ただ、オープンデータを活用していこうという枠組みのなかで、まだまだデータサイエンティストの数が足りていないという問題もあります。

そこで、100万人のデータサイエンティストを育成するという目標の元で、「Big Data University」というサービスを展開しています。

RやPythonを使った機械学習の教育や、HadoopやSparkのデータ分析を学べるサービスです。それ以外にも、Data Scientist Workbenchというツールも無償で提供して、データサイエンスを促進しています。

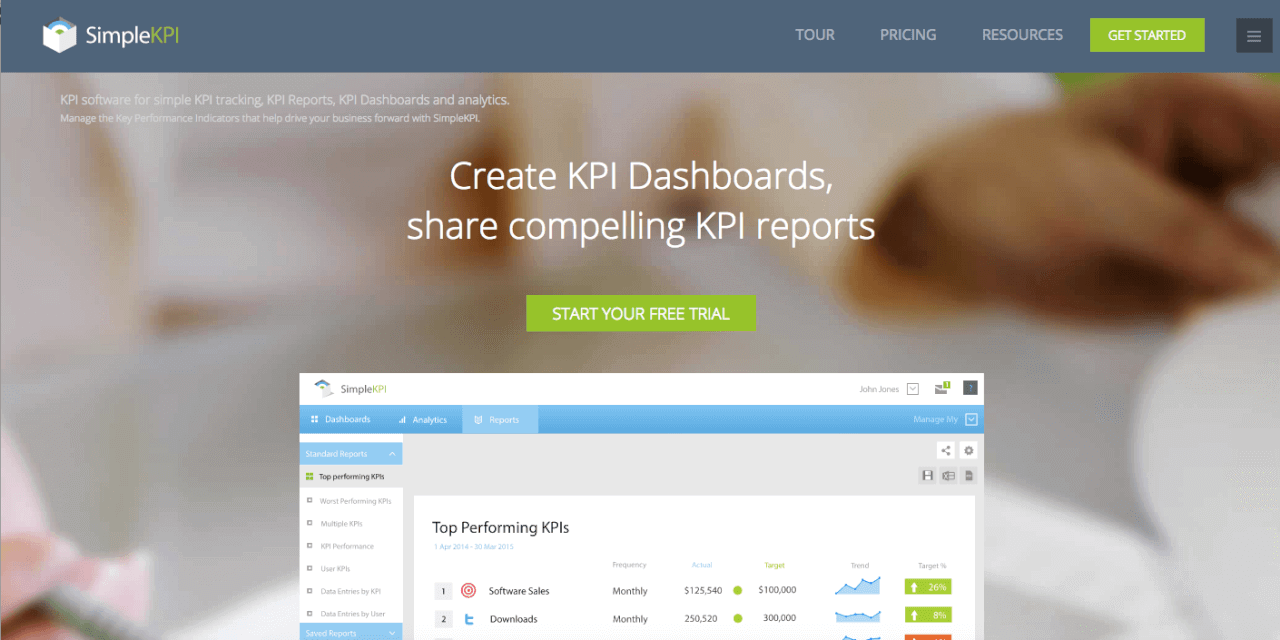

▼IBMが提供する「Big Data University」のサイト

技術は人の仕事を奪うわけではなく、高度化させていくもの

ビッグデータを扱っていると、ディープラーニングの話が出てきて「将来人間の仕事はなくなる」といった話になることが多いですね。けれど私たちは、その仕事自体がなくなるわけではなく、より高度化していくと考えています。

弊社ではAIではなく「コグニティブ(経験的知識に基づく)システム」と呼んでいるのですが、データを理解し、学習するようなシステムが実現できれば、人がより高度な事をできるようになる。やる内容が変わっていくだけで、仕事自体はなくなることはないんです。

こうした技術のおかげでシステムはよりコグニティブ(自ら思考できるよう)になり、結果的に私たちは、より多くの情報に基づいて確実性の高い意思決定ができるようになると考えています。(了)

【読者特典・無料ダウンロード】「秒で変わるAI時代」に勝つ。最新AIツール完全攻略ガイド

近年、AI関連サービスは爆発的なスピードで進化しています。毎日のように新しいツールがリリースされる一方で、SNS上では広告色の強い情報や、過大評価されたコメントも多く見受けられます。

情報量があまりにも多く、さらにノイズも混ざる中で、「自分にとって本当に使えるツール」にたどり着くことは、簡単ではありません。だからこそ、「正しい情報源を選び、効率的にキャッチアップすること」が、これまで以上に重要になっています。

そこで今回は、SELECK編集部が日々実践している「最新AIツール情報の探し方・選び方・使い方」のノウハウに加えて、編集部が推薦する、現場で使えるAIツール22選をすべてまとめてお届けします。